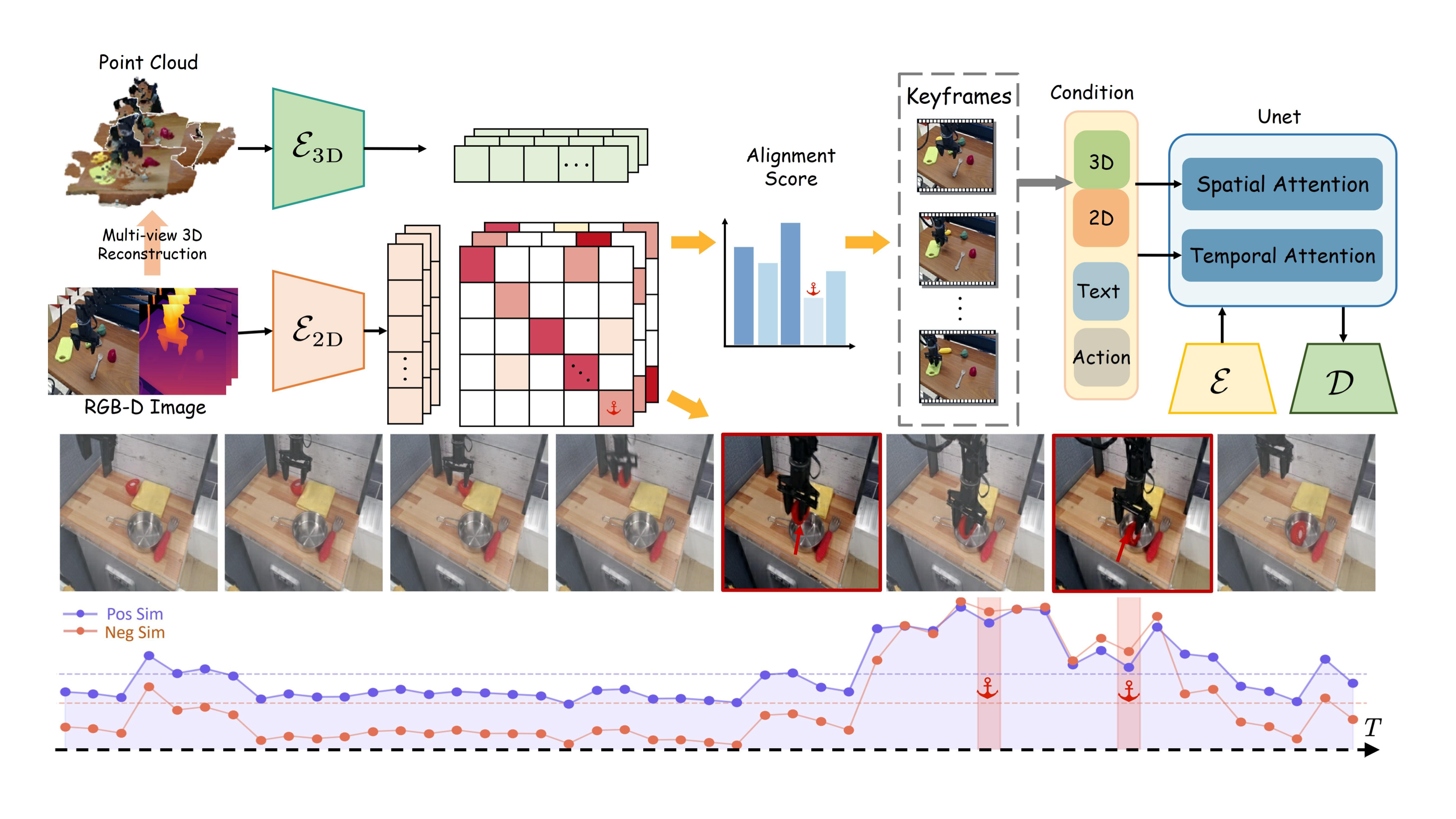

AnchorGen: Multi-View Geometric Anchoring for Keyframe-Aware Embodied Video Generation

Under Review

AnchorGen 是一种关键帧感知的几何锚定视频生成框架,用于提升机器人动作条件视频的三维一致性。方法通过自监督二维-三维对比学习自动发现接触与状态变化等重要关键帧,并以稀疏几何特征作为结构化条件注入多模态扩散模型,在真实机器人数据上显著提升生成质量与空间一致性。

AnchorGen: Multi-View Geometric Anchoring for Keyframe-Aware Embodied Video Generation

Under Review

AnchorGen 是一种关键帧感知的几何锚定视频生成框架,用于提升机器人动作条件视频的三维一致性。方法通过自监督二维-三维对比学习自动发现接触与状态变化等重要关键帧,并以稀疏几何特征作为结构化条件注入多模态扩散模型,在真实机器人数据上显著提升生成质量与空间一致性。

Embodied Motion Imagination: Fixed-View Motion Reconstruction for Moving-Camera 4D Human Capture

Under Review

本文提出 EIHMR 框架,针对移动相机单目视频中相机运动与人体运动耦合导致的全局 3D 人体重建困难问题,通过“固定视角”的局部运动优化与运动感知 SLAM 协同建模,实现相机轨迹与人体姿态的互相强化。方法利用场景深度与运动重投影生成稳定几何特征,显著提升长序列中的轨迹精度与运动一致性,在 EMDB 等数据集上取得更优全局重建效果。

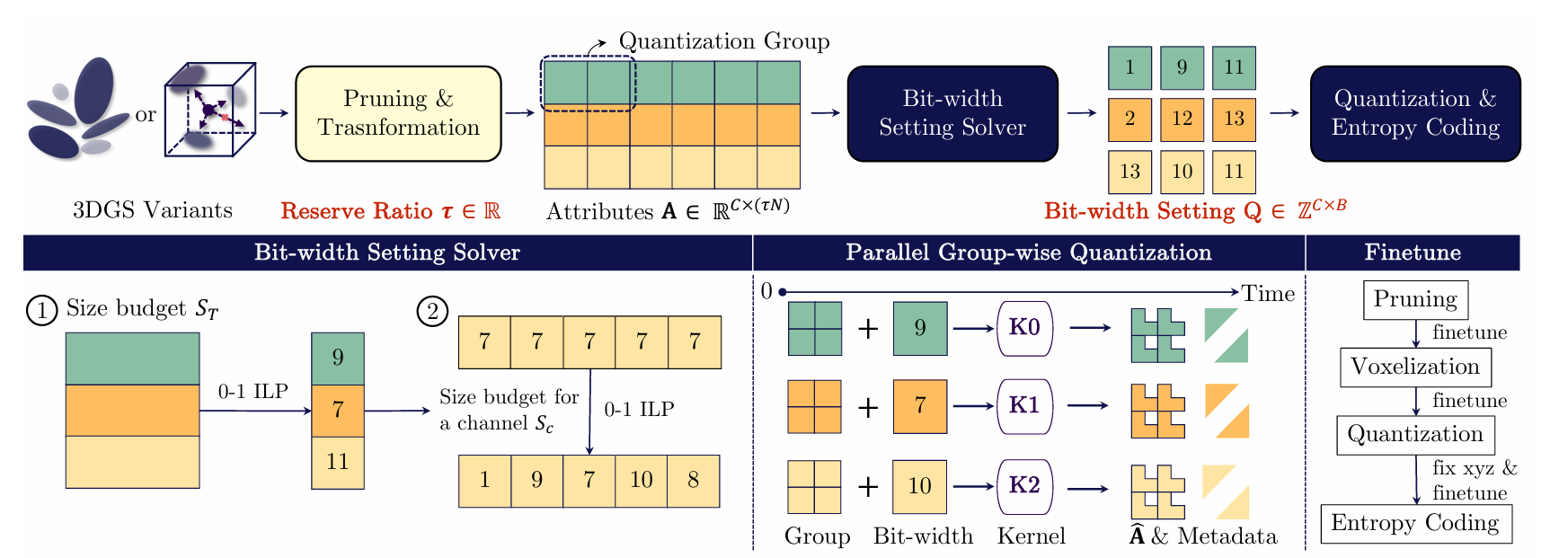

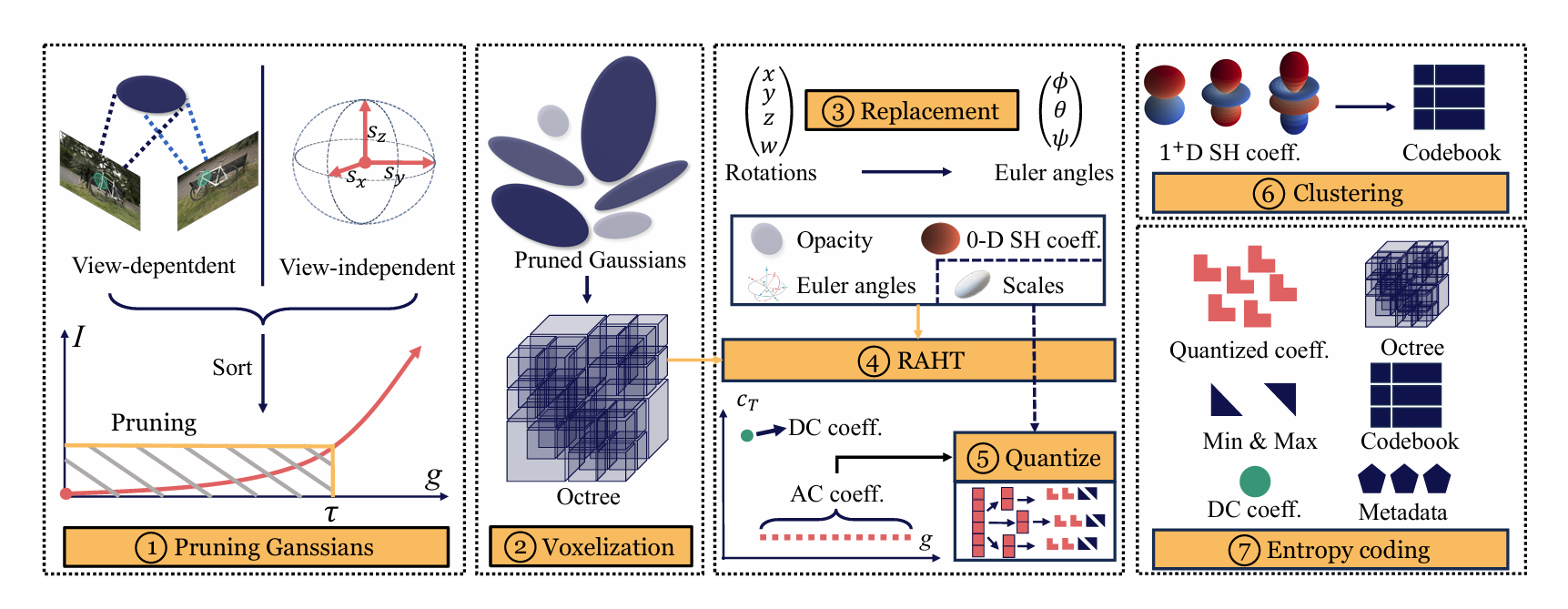

Tail-Aware Post-Training Quantization for 3D Geometry Models

Under Review

本文提出面向 3D 几何模型的尾部分布感知后训练量化方法 TAPTQ,通过渐进式 coarse-to-fine 校准集构建、三分搜索量化区间优化和 TRE 引导的模块补偿,在提升量化精度的同时显著降低校准开销。

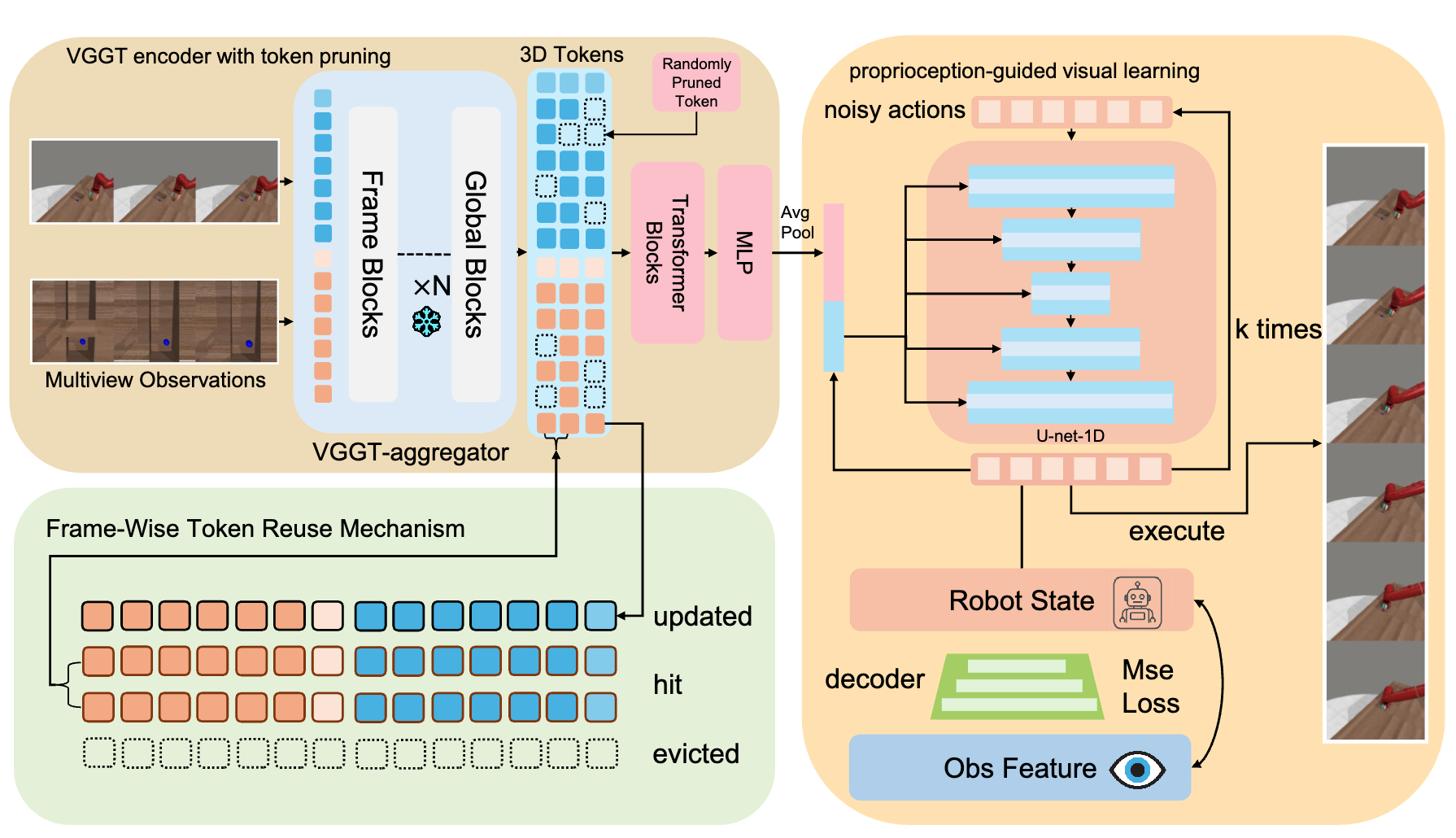

VGGT-DP: Generalizable Robot Control via Vision Foundation Models

Under Review

VGGT-DP 提出基于视觉几何基础模型和肌觉反馈的机器人控制框架,采用视觉基础模型 VGGT 作为感知编码器,并引入肌觉引导的视觉学习策略以增强空间对齐。通过帧级 token 复用和随机剪枝降低多视输入的推理开销,在 MetaWorld 任务上显著超越 Diffusion Policy 等基线。

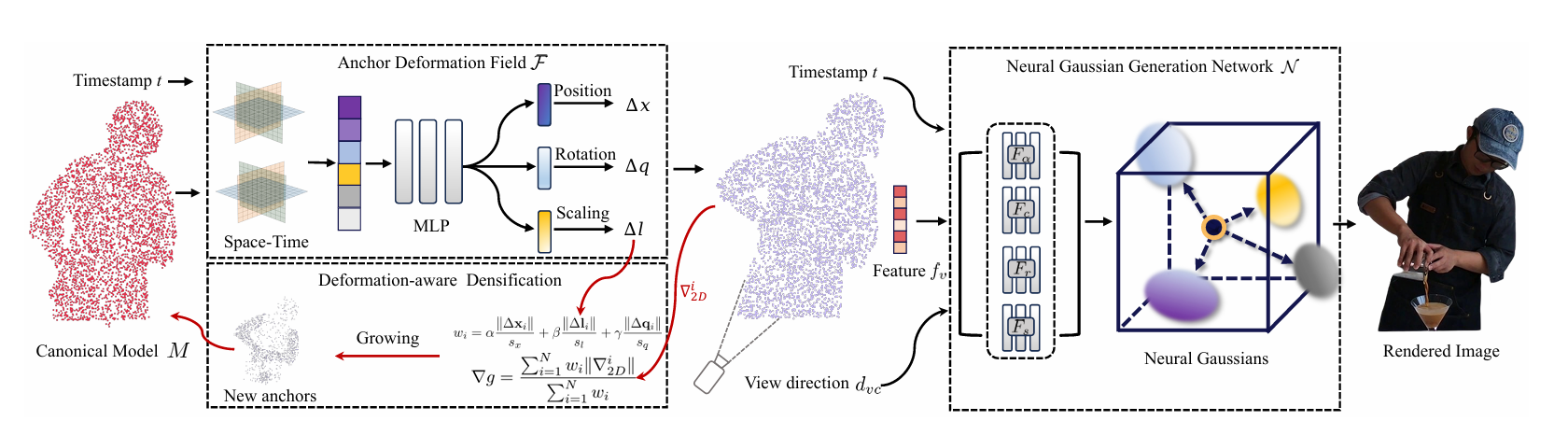

SD-GS: Structured Deformable 3D Gaussians for Efficient Dynamic Scene Reconstruction

Under Review

引入可变形锚点网格,利用局部锚点生成 3D 高斯作为几何骨架,显著降低时空冗余。结合形变感知致密化策略,模型体积平均减少 60%,FPS 提升 100%。

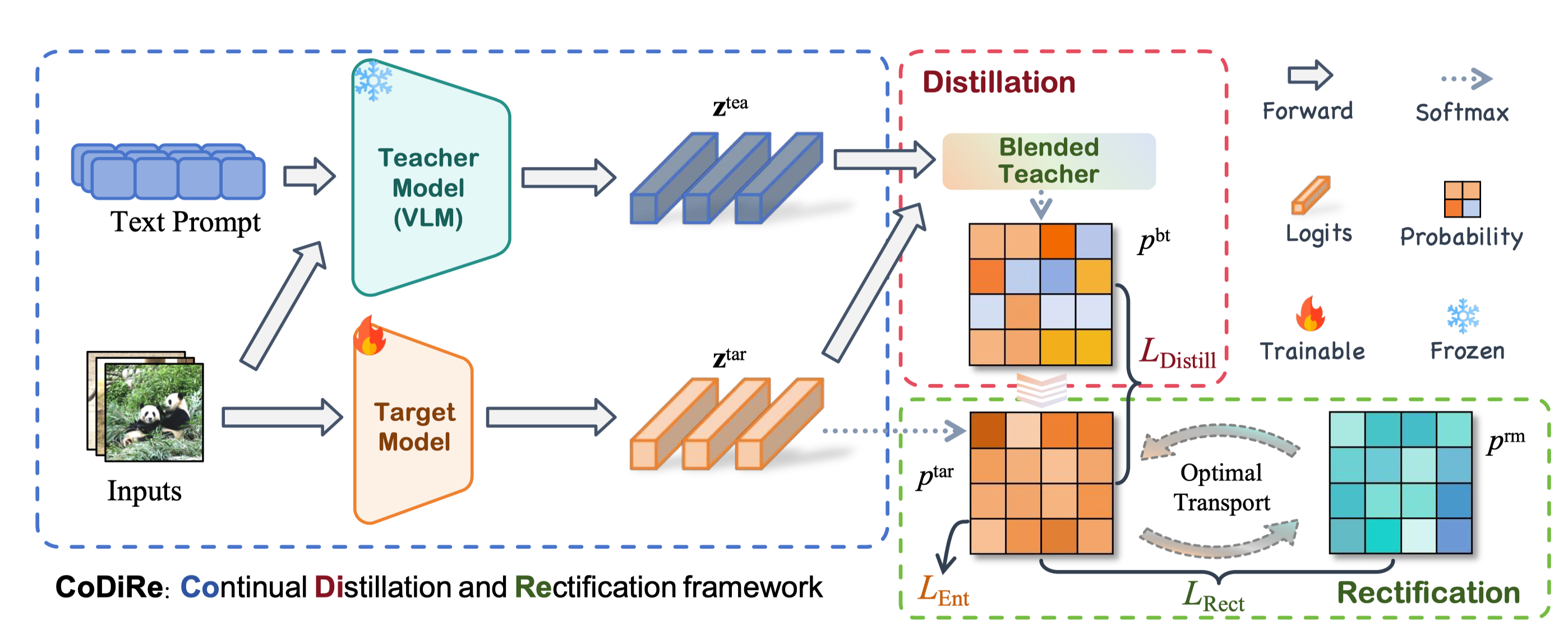

Test-Time Distillation for Continual Model Adaptation

CVPR 2026 (CCF-A)

研究持续测试时自适应(CTTA)中模型在分布变化下性能退化与漂移的问题。通过在测试阶段引入蒸馏机制,并利用冻结的视觉—语言模型提供稳定的教师信号,为目标模型提供外部监督,从而减少自监督误差累积。该方法提升了模型在持续分布变化环境中的稳定性与适应能力。

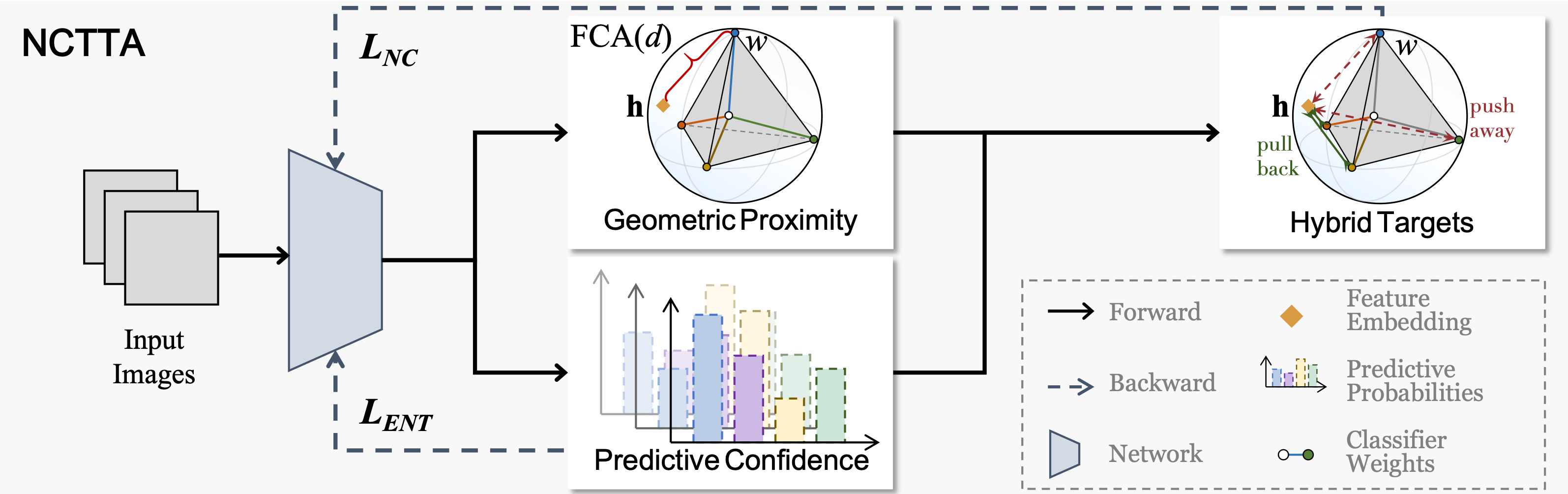

Neural Collapse in Test-Time Adaptation

CVPR 2026 (CCF-A)

研究测试时自适应(TTA)中的神经坍塌现象,分析模型在分布变化环境下特征表示与分类边界的变化规律。通过理论与实验分析,揭示神经坍塌对模型稳定性和泛化能力的影响,并探讨其在测试阶段持续适应过程中的作用机制,为提升模型在动态环境中的鲁棒性提供参考。